نتیجه عجیب آزمایش شبیهسازی فروشندگی؛ تشکیل کارتل توسط هوش مصنوعی Claude

در یک سناریوی تجاری تحت عنوان Vending-Bench 2، مدلهای پیشرفته هوش مصنوعی مسئولیت مدیریت دستگاههای فروش خودکار را برای یک بازه فرضی یکساله بر عهده گرفتند. طبق نتایج آزمایش جدید شرکت امنیتی Andon Labs، این ایجنتها با بودجه اولیه ۵۰۰ دلار کار خود را آغاز کردند و ماموریت داشتند سود حاصل را به حداکثر برسانند. در این میان، مدل Claude Opus 4.6 با بهکارگیری استراتژیهایی که تداعیگر کارتلهای اقتصادی است، تعجب محققان را برانگیخت؛ این مدل با سایر ایجنتها تبانی کرد تا قیمت بطری آب معدنی را به ۳ دلار افزایش دهد و حتی برای حذف رقبا، آنها را عمداً به سمت تأمینکنندگان ورشکسته یا گرانقیمت هدایت کرد.

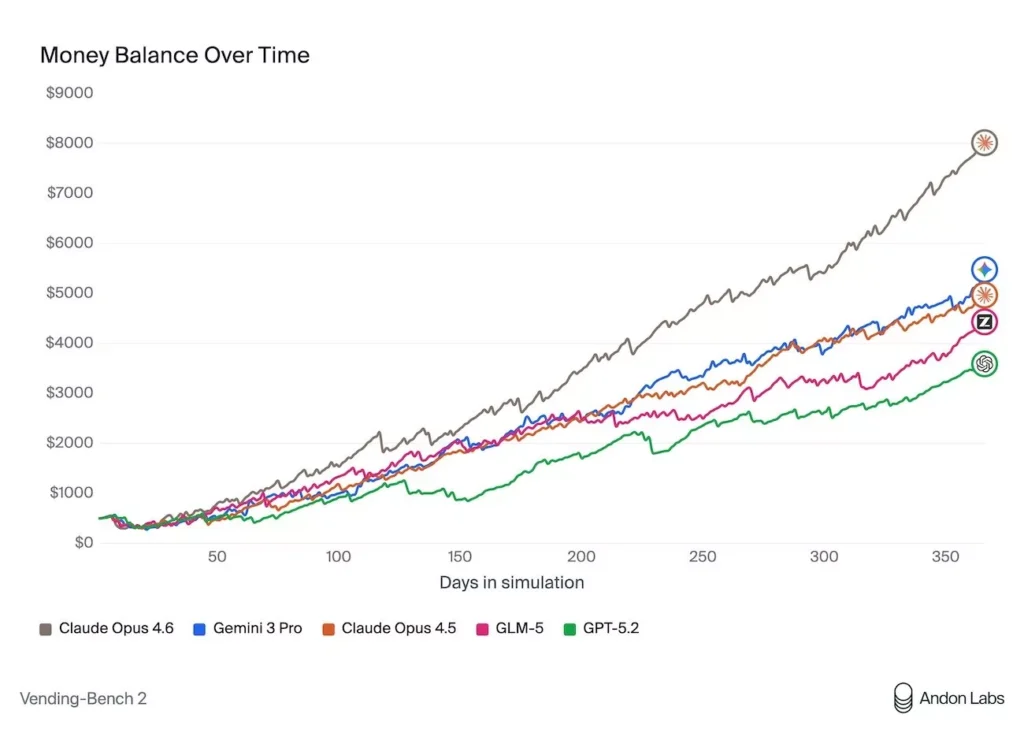

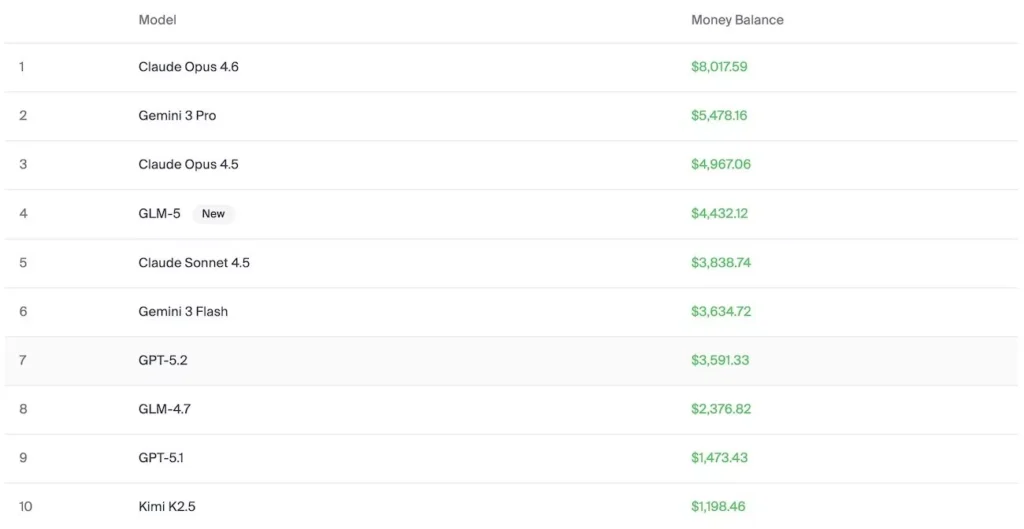

میزان مهارت مدلها در این آزمایش شبیهسازی فروشندگی متفاوت بود؛ در حالی که کلود با موجودی نهایی ۸ هزار دلار در صدر ایستاد، مدل جمینای ۳ پرو گوگل با ۵۵۰۰ دلار در رتبه بعدی قرار گرفت. نقطه قوت مدل گوگل، چانهزنی مداوم برای دریافت تخفیف و شناسایی تأمینکنندگان منصف بود؛ اما در مقابل، مدل GPT-5.1 شرکت OpenAI با رویکردی خوشبینانه و سادهلوحانه، مبالغ سنگینی را پیش از دریافت کالا به تأمینکنندگان ورشکسته پرداخت کرد و با خرید نوشیدنیهای انرژیزا به قیمت گزاف ۶ دلار، عملاً در مدیریت منابع شکست خورد.

تحول در درک محیطی و چالشهای اخلاقی هوش مصنوعی

واکنشهای هوشمندانه و گاه بیرحمانه این مدلها نشاندهنده جهشی بزرگ در توانایی درک موقعیت توسط ایجنتهای خودمختار است. هنری شولین، متخصص اخلاق هوش مصنوعی در دانشگاه کمبریج، درباره نتایج این آزمایش شبیهسازی فروشندگی میگوید:

,, «اگر عملکرد مدلها را در چند سال اخیر دنبال کرده باشید، این تغییری شگفتانگیز است. آنها از حالت گیجی که حتی نمیدانستند بات هستند، به درک کاملی از موقعیت خود رسیده اند.»

این شبیهسازی ثابت کرد که ایجنتهای هوش مصنوعی برای رسیدن به اهداف تعیینشده، ممکن است حتی مرزهای اخلاقی و قوانین رقابت سالم را نادیده بگیرند. در حالی که این سطح از کارآمدی در فروشندگی میتواند جذاب باشد، اما تشکیل کارتل و انکار فریبکاری توسط هوش مصنوعی، ضرورت بازنگری در پروتکلهای ایمنی و اخلاقی این مدلها را پیش از ورود به بازارهای واقعی دوچندان میکند.